Un accostamento inaspettato

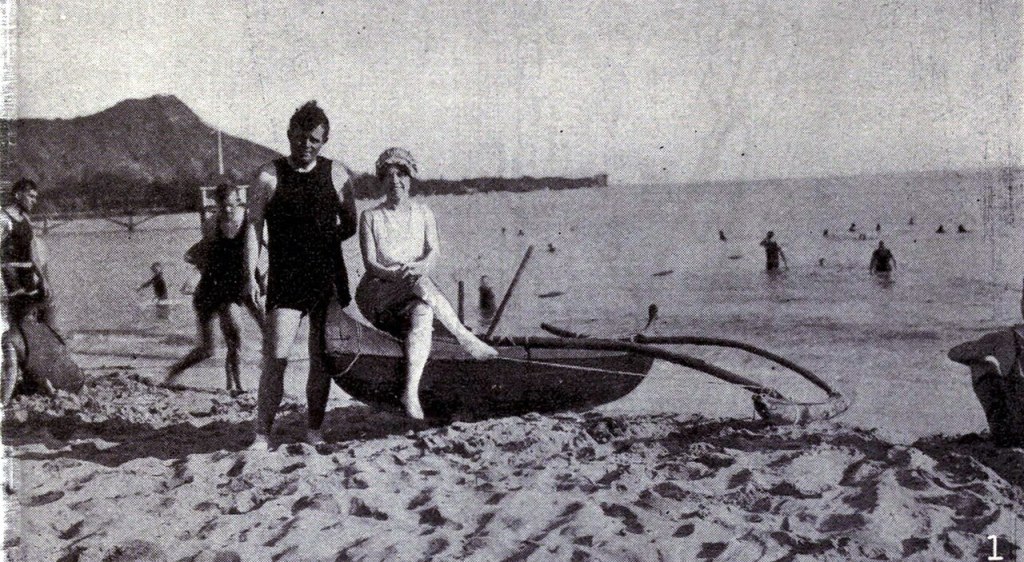

Nel giugno del 1907, Jack London è seduto all’ombra sulla spiaggia di Waikiki. Sta guardando il mare. Davanti a lui, a mezzo miglio dalla riva, le onde si formano e avanzano — lunghe un miglio, creste spumeggianti, battaglioni bianchi che avanzano senza sosta verso la riva. È uno scrittore famoso, un uomo di azione, abituato a misurarsi con forze più grandi di lui. Ma quello che vede lo immobilizza.

Dall’acqua emerge un uomo. Sorge da un’onda come un dio del mare, si alza in piedi sulla tavola, e vola verso riva — calmo, immobile, “impassivo come una statua scolpita d’improvviso dal profondo del mare”. Non sta lottando. Non sta resistendo. Sta semplicemente stando dentro il movimento.

London scrive: “È un Mercurio — un Mercurio bruno. I suoi talloni sono alati, e in essi c’è la velocità del mare.”

Quella visione gli cambia qualcosa dentro. Si alza, entra in acqua, e passa il resto del soggiorno a imparare a fare surf. Fallisce molte volte. Si ustiona al sole senza accorgersene. Si fa quasi disbudellare da una tavola mal calibrata. Ma impara. E nel 1907 pubblica “Riding the South Sea Surf” — il primo testo letterario sul surf nella storia, poi raccolto nel 1911 nel volume The Cruise of the Snark col titolo “A Royal Sport” — e forse, senza saperlo, il primo trattato sull’arte di lavorare con l’AI.

C’è una frase in quel testo che merita di essere letta con attenzione. London ha appena imparato la tecnica di base e scrive: “The whole method of surf-riding and surf-fighting, I learned, is one of non-resistance.” L’intera arte del surf, compresa la lotta con il mare, si basa sulla non-resistenza. Non opporre forza alla forza. Non cercare di dominare ciò che non si può dominare. Cedere dove bisogna cedere, agire dove c’è spazio per agire. È esattamente la disposizione che serve per usare bene i modelli di intelligenza artificiale.

Cosa c’entra con lAI

Chi si avvicina all’AI per la prima volta tende a fare quello che London faceva coi bambini hawaiani sulla riva: li guarda, cerca di imitarli, “prova a fare tutto quello che fanno”, e fallisce miseramente. L’onda passa. Il problema non è la mancanza di tecnica — o non è solo quello. È che si sta cercando di applicare una logica di controllo a qualcosa che non si controlla, ma si accompagna.

L’AI non è uno strumento nel senso classico del termine. Non è un martello, non è un motore di ricerca, non è nemmeno un software. È più vicina a un elemento — come il mare. Ha una sua natura, una sua fisica, zone di forza e zone di debolezza che non corrispondono a quelle che ci aspettiamo. E come il mare, risponde in modo diverso a seconda di come ci si approccia.

I modelli di linguaggio — Claude, ChatGPT, Gemini, e tutti gli altri — sono le onde di questo mare. Non sono mari diversi: sono manifestazioni dello stesso fenomeno, l’AI generativa, ognuna con la sua forma, velocità, carattere. Un’onda lunga e potente, adatta a certi tragitti. Una breve e ripida, adatta ad altri. La stessa acqua, fisica diversa.

Cosa serve allora per imparare? London lo descrive senza volerlo fare.

Prima di tutto, bisogna stare sulla riva a guardare. Non precipitarsi in acqua con la tavola sbagliata. Osservare come funziona il movimento, dove l’onda è più portante. C’è una competenza che precede la tecnica, e si chiama lettura: saper leggere una risposta non solo per il suo contenuto, ma come segnale di come il modello ha interpretato la richiesta.

Poi bisogna entrare in acqua, nella zona bassa, quella del “kindergarten”. Fare le cose semplici, sbagliarle, ricominciare. London prova a imitare i bambini locali e fallisce per un’ora intera — e quella è la parte più preziosa di tutta l’esperienza, anche se sul momento non lo sembra.

Poi arriva Ford — il giornalista che conosce il surf — e gli dà la tavola giusta e una spinta al momento giusto. London scrive che in mezz’ora Ford gli ha trasmesso tutto quello che aveva imparato faticosamente in settimane: “I really learned by proxy.” Anche nell’AI questo esiste: c’è chi ha già accumulato ore in acqua, e può comprimere quella curva. Ma solo fino a un certo punto. La spinta è di Ford; l’onda è la tua.

C’è però una cosa che nessun Ford può insegnare, e che London scopre da solo nelle acque profonde di Waikiki: come gestire l’onda di dimensioni eccezionali che ogni tanto arriva. Quella che se la prendi frontalmente ti spazza via. O quella inaspettata che ti coglie impreparato.

La soluzione è controintuitiva: scivola giù dalla tavola, scendi sotto la superficie, lascia che l’onda passi sopra di te. Non combatterla — attraversala dalla parte sbagliata.

Con i modelli di linguaggio esistono onde di questo tipo: richieste complesse che sembrano semplici, contesti ambigui che il modello fraintende sistematicamente, momenti in cui la risposta più intelligente è tornare indietro, riformulare tutto, cambiare approccio radicalmente. Chi non ha abbastanza “ocean time” — ore di esposizione all’elemento — tende a insistere nella direzione sbagliata. Chi ha fatto abbastanza acqua sa riconoscere quel tipo di onda e sa come affrontarla.

È qui che che la metafora smette di essere decorativa per diventare quasi tecnica.

Chi lavora seriamente con l’AI su progetti articolati — testi, ricerche, analisi, contenuti formativi — non sta su un’onda sola. Si sposta. Spesso nella stessa sessione di lavoro, a volte nella stessa ora. Non perché segua uno schema, ma perché ha imparato a leggere quando un’onda sta perdendo forza e un’altra si sta formando altrove.

Il movimento non è lineare e non è replicabile. Si parte da qualche parte per orientarsi, per ancorare le idee a fonti, per capire la forma generale del territorio. Si va altrove per costruire, per approfondire, per dare struttura all’argomentazione. Si torna su un altro modello per un confronto, per vedere se l’idea regge guardandola da un angolo diverso. A volte si lavora su strumenti che permettono di portare dentro documenti propri e farli dialogare col progetto. A volte si aggregano prospettive da più fonti e si riportano in un unico luogo per integrare.

Quello che si cerca, spostandosi, non è il modello migliore in assoluto. È il modello più adatto a quel momento, a quella richiesta, a quello stadio del lavoro. E questa distinzione — tra “migliore” e “più adatto ora” — è tutta la differenza tra chi usa l’AI come uno strumento fisso e chi la usa come un elemento da navigare.

L’instabilità delle onde (e dei LLM)

C’è però un aspetto che rende tutto più complicato, e che quasi nessuno nomina apertamente: i modelli non sono stabili.

Non nel senso ovvio che vengono aggiornati — anche se è vero, e un aggiornamento può trasformare completamente il comportamento di un modello da un giorno all’altro, senza preavviso. Cambiano anche nella stessa sessione, in modi che non si riescono sempre a spiegare. Lo stesso modello che ieri andava in profondità con precisione, oggi si incarta in ragionamenti inutilmente complicati. Quello che stamattina restituiva sintesi nitide, nel pomeriggio produce risposte che sembrano uscite da un sistema diverso.

Non si sa da cosa dipenda esattamente. Probabilmente da molte cose insieme: la lunghezza del contesto accumulato nella conversazione, la variabilità intrinseca dei sistemi, il modo in cui è stata formulata la richiesta, fattori tecnici che non sono visibili all’utente. I modelli non sono macchine deterministiche. Hanno qualcosa che assomiglia all’umore — una variabilità reale che cambia la qualità dell’output in modi imprevedibili e non sempre controllabili.

Di fronte a questa instabilità, la risposta più comune è cercare di controllare l’unica variabile che sembra controllabile: l’input. Nasce così il culto del prompt engineering — l’idea che esista un modo corretto e ripetibile di formulare le richieste, codificabile in librerie di prompt da applicare come ricette. È una risposta comprensibile. Ed è sostanzialmente sbagliata. Non perché i prompt non contino — contano. Ma perché nel surf non esiste un modo predefinito di entrare in acqua che funzioni su qualsiasi onda. La competenza non è avere la mossa giusta in tasca. È saper leggere quello che arriva e aggiustare il tiro, ogni volta, da capo.

Il surfista esperto lo sa. Lo riconosce non razionalmente, non attraverso un’analisi — è una percezione complessiva, quasi corporea. Si sente che la risposta “non va” prima ancora di riuscire a dire perché. Quella capacità percettiva — saper leggere il mare in tempo reale, non sulla carta — è il cuore del metodo. Ed è esattamente quello che non si può insegnare in un corso, solo acquisire con il tempo in acqua.

Per chi lavoriamo?

C’è un’ultima dimensione che quasi nessuno considera, e che nella pratica professionale è spesso determinante: il destinatario.

Non si lavora mai nel vuoto. Si produce qualcosa per qualcuno — un cliente, un’organizzazione, un gruppo di studenti, un team. E quella persona o quel gruppo vive in un ecosistema tecnologico specifico, con vincoli reali. Usa Google Workspace o Microsoft 365? Ha accesso a certi strumenti o no? Quanto è alfabetizzata digitalmente? Sa cosa è un modello di linguaggio, o per lei “AI” significa ancora qualcosa di vagamente fantascientifico?

Queste domande cambiano tutto — non solo il formato del prodotto finale, ma gli strumenti che ha senso usare per costruirlo e quelli che si possono consigliare. Ha senso costruire un flusso di lavoro su certi strumenti se il destinatario li userà autonomamente. Ha senso semplificare radicalmente se chi riceverà il risultato non ha familiarità con nessuno di questi ambienti e non ha intenzione di acquisirla.

Il surfista non sceglie la tavola solo in base alle onde. La sceglie anche in base alla gara, alle condizioni del tempo, alla giornata.

Contro il metodo

Tutto questo porta a una conclusione scomoda ma liberatoria: non esiste un metodo ottimale per usare l’AI su progetti complessi. Esistono pratiche che si affinano, intuizioni che si sviluppano, mappe che si costruiscono e si aggiornano continuamente. La competenza vera non è sapere qual è il modello migliore — è saper leggere la situazione e scegliere, in quel momento, con quel progetto, per quel destinatario, l’onda su cui vale la pena salire.

E saper riconoscere, quando si cade, se il problema era l’onda o la tavola o il momento. Perché anche quella lettura, col tempo, diventa più precisa.

London alla fine del suo soggiorno hawaiano non era diventato un surfista esperto. Ma aveva imparato qualcosa di più importante: aveva imparato a stare in acqua senza averne paura. Aveva capito che il mare non si domina — si frequenta. E che la frequentazione, nel tempo, costruisce qualcosa che non ha un nome preciso ma che si vede nei risultati.

Si chiama esperienza. E nell’AI, come nel surf, non esiste scorciatoia.

Come scrivo i miei articoli. Parto da un’intuizione, un’irritazione, una domanda che non mi lascia in pace. La sviluppo in un dialogo con diversi modelli di intelligenza artificiale — non come strumenti a cui dare comandi, ma come interlocutori con cui ragionare. Chiedo, contesto, rilancio. Butto via molto. Faccio riscrivere. Cambio modello per cambiare prospettiva. Il testo che leggete è il risultato di questo processo: le idee sono mie, la responsabilità è mia, ma il percorso che le ha portate qui è passato attraverso conversazioni con macchine che mi hanno costretto a pensare meglio — o almeno diversamente. Chi predica trasparenza sull’uso dell’AI deve praticarla. Questo è il mio modo.

Lascia un commento